(实习生杨嘉宁对本文亦有贡献)

近年来,未成年人在网络空间的安全问题备受关注,例如,私下大额充值游戏账号,参与直播间巨额打赏;沉迷网络社交平台,影响正常学习生活;跟风发布“擦边”内容,被算法推荐给不特定群体,使未成年人身心健康受到负面影响等。

为解决以上乱象,根据《未成年人保护法》《网络安全法》《个人信息保护法》与未成年人网络保护有关的各项规定,国务院发布的《未成年人网络保护条例》(“条例”)将于2024年1月1日实施。《条例》针对未成年人网络素养促进、网络信息内容规范、个人信息网络保护以及网络沉迷防治作出了具体的规制,创新性地提出了智能终端产品制造者和销售者的义务,未成年人用户数量巨大或者对未成年人群体具有显著影响的网络平台服务提供者的义务等。

《条例》第19条规定了未成年人网络保护软件、专门供未成年人使用的智能终端产品应当具有有效识别违法信息和可能影响未成年人身心健康的信息、保护未成年人个人信息权益、预防未成年人沉迷网络、便于监护人履行监护职责等功能,并授权国家网信部门会同国务院有关部门制定相关技术标准或要求,指导监督网络相关行业组织按照标准进行评估。

这并非法律法规首次关注未成年人使用智能终端产品。《未成年人学校保护规定》第33条已经提出,“学校可以禁止学生携带手机等智能终端产品进入学校或者在校园内使用;对经允许带入的,应当统一管理,除教学需要外,禁止带入课堂。”

值得注意的是,《条例》专门提出了“智能终端产品”的定义,即可以接入网络、具有操作系统、能够由用户自行安装应用软件的手机、计算机等网络终端产品。从定义看,具备以上三个特征的还可能包括智能眼镜、智能手表等穿戴设备、智能屏幕等。因此,相关产品的制造商,如果生产专供未成年人使用的产品,应注意符合本条例规定。而学校也可以援引《条例》该定义,制定更为细化的智能终端产品管理规定。

《条例》还延续了《未成年人保护法》第69条第2款的规定,要求智能终端产品制造者、销售者应当安装未成年人网络保护软件,或采用显著方式告知安装渠道和方法。

上述两项规定结合,形成了智能终端产品领域的未成年人网络保护全覆盖态势。对于专门供未成年人使用的相关产品,应当本身就具备未成年人网络保护功能;而对于一般人使用的相关产品,则应当安装或能够安装未成年人保护软件。

《条例》第20条规定了“未成年人用户数量巨大或者对未成年人群体具有显著影响的网络平台服务提供者”的义务。此款规定可以参考《个人信息保护法》第58条“提供重要互联网平台服务、用户数量巨大、业务类型复杂的个人信息处理者”的定义。但是“数量巨大”应当以多少为界,以及二者之间关系,还有待监管部门进一步明确。

第20条的具体内容包括:

(1)定期开展未成年人网络保护影响评估。《条例》没有明确评估具体应当包含的内容及保持年限,但笔者认为,应当至少包括《未成年人保护法》和《条例》中所规定的内容,以及《个人信息保护法》中关于个人信息保护影响评估的内容,并参照个人信息保护影响评估的三年保存要求。

(2)提供未成年人模式或者未成年人专区等,便利未成年人获取有益身心健康的平台内产品或者服务。实践中可以参考bilibili的青少年模式,在首页精选教育类、知识类内容。

(3)成立主要由外部成员组成的独立机构,对未成年人网络保护情况进行监督。《个保法》第58条要求重要互联网平台建立类似的独立机构,对个人信息保护情况进行监督。如果同时适用如上两个要求的企业可以考虑设置一个机构,兼顾以上两方面的监督义务。

(4)遵循公开、公平、公正的原则,制定专门的平台规则,明确平台内产品或者服务提供者的未成年人网络保护义务,并以显著方式提示未成年人用户依法享有的网络保护权利和遭受网络侵害的救济途径。

(5)对严重侵害未成年人身心健康或者侵犯未成年人其他合法权益的平台内产品或者服务提供者,停止提供服务。

(6)每年发布专门的未成年人网络保护社会责任报告,并接受社会监督。对比《个保法》第58条,重要互联网平台也需要“定期”发布个人信息保护社会责任报告,接受社会监督。

1.不同类型的网络信息所对应的管制要求

《条例》针对四种涉及未成年人的网络信息分别制定了相适应的管理措施,其分别为:

(1)有关未成年人的淫秽色情网络信息;

(2)含有危害未成年人身心健康内容的网络信息;

(3)可能影响未成年人身心健康的信息;

(4)商业营销信息。

对于有关未成年人的淫秽色情信息,《条例》延续《未成年人保护法》于2021年修订时增添的第52条规定,借鉴国际通行做法,禁止一切制作、复制、发布、传播和持有行为,使其受到最严格的监管,即只要“持有”即违法。不过,“持有”行为所对应的罚则尚未明确,有待《治安管理处罚法》以及《刑法》作出相应的修订。

而对于含有危害未成年人身心健康内容的网络信息,《条例》虽未禁止持有,但也禁止了一切制作、复制、发布、传播和向未成年人发送、推送或者诱骗、强迫未成年人接触的行为,以阻断这类高危信息以任何形式出现在网络空间,危害未成年人。

至于可能影响未成年人身心健康的信息,由于危害程度较低,《条例》仅规定,相关方需要在信息展示前予以显著提示,并禁止在首页首屏、弹窗、热搜等处于产品或者服务醒目位置、易引起用户关注的重点环节呈现。同时,针对向未成年人发送这类信息的某些恶意人群,《条例》专门规定,禁止在专门以未成年人为服务对象的网络产品和服务中制作、复制、发布、传播这类信息,也禁止向未成年人发送、推送或者诱骗、强迫未成年人接触这类信息。可以认为,这类信息可以在互联网上以合法的形式存在或传播,相关方仅需要在合理范围内防止未成年人接触到即可。

值得注意的是,《条例》特别要求国家网信部门会同相关国家部门确定可能影响未成年人身心健康的信息的具体种类、范围、判断标准和提示办法。这将意味着针对这类信息的执法将进入明确范围、严格执法的新时代。同时,成年人在合法的前提下制作、接触、利用乃至传播这类信息所受到的法律限制也可能会减小。

最后,关于商业营销信息,《条例》规定禁止通过自动化决策的方式向未成年人施加商业影响。《个人信息保护法》仅规定应当同时提供不针对其个人特征的选项或者提供便捷的拒绝方式,而《条例》则更进一步,一律禁止针对未成年人的自动化决策式商业营销。其背后逻辑是未成年人因缺乏判断力自行或由父母、监护人拒绝或选择非个性化营销存在实际困难。

上述四种涉及未成年人的网络信息、以及《条例》所提出的对应要求,总结如下:

2.网络欺凌行为

《条例》延续《未成年人保护法》的做法,将网络欺凌行为定义为:包括侮辱、诽谤、威胁或者恶意损害形象等。最高法、最高检和公安部发布的《关于依法惩治网络暴力违法犯罪的指导意见》中,网络暴力定义则是“针对个人肆意发布谩骂侮辱、造谣诽谤、侵犯隐私等信息的网络暴力行为,贬损他人人格,损害他人名誉”。网络欺凌与网络暴力二者之间的具体关系,尚待相关部门进一步明确。

针对网络欺凌行为,《条例》第26条规定网络产品和服务提供者应当建立预警预防、识别检测和处置机制。其具体包括:

在防护手段上,设置便利未成年人及其监护人保存遭受网络欺凌记录、行使通知权利的功能与渠道,提供未成年人屏蔽陌生用户、设置信息可见范围、禁止转载或者评论本人发布信息、禁止向本人发送信息等防护选项。

在识别手段上,建立网络欺凌信息特征库,运用算法模型与人工智能、大数据等技术手段和人工审核的方式进行监测。

3.适龄要求

针对专门以未成年人为服务对象的在线教育网络产品和服务提供者,《条例》第28条要求根据不同年龄阶段未成年人身心发展特点和认知能力提供相应的产品和服务。

相关企业可以参考网信办发布的《移动互联网未成年人模式建设指南(征求意见稿)》中有关移动互联网应用程序未成年人模式的要求。在未成年人模式下应提供分龄内容服务,并打造专属内容池。

4.事前预防与事后处置

《条例》第29条对信息发布管理采取了事前预防与事后处置的要求。在事前预防层面,网络产品和服务提供者应当防止用户制作、复制、发布、传播违反《条例》的信息。企业在合规工作中可以参考《网络信息内容生态治理规定》第9条的规定,健全用户注册、账号管理、信息发布审核、跟帖评论审核、版面页面生态管理、实时巡查、应急处置和网络谣言、黑色产业链信息处置等制度,设立网络信息内容生态治理负责人,配备专业人员等,完善对用户发布信息的管理。此外,还可以参考《民法典》第1195—1197条关于收到被侵权人通知后,采取删除、屏蔽、断开链接等措施的制度。

1.年龄核验与身份认证系统

《未成年人保护法》第75条规定,网络游戏需建立未成年人网络游戏电子身份认证系统;第76条规定,网络直播服务提供者不得为未满16周岁的未成年人提供网络直播发布者账号注册服务,可以对年满16周岁的未成年人提供网络直播发布者账号注册服务,应当对其身份信息进行认证,并征得其监护人同意。

《条例》则在此基础上增加了“对未成年人提供信息发布、即时通讯等服务的网络服务提供者”应当由未成年人或其监护人提供未成年人真实身份信息,否则不得为未成年人提供相关服务。《条例》还对“网络直播服务提供者”增加了一条义务,要求建立网络直播发布者真实身份信息动态核验机制,完善了监管链条。尽管网络服务提供者一般遵循最小必要原则,不过多获取用户个人身份信息。但是在游戏、直播等场景下,未成年人常利用成年人身份信息、租赁账号、第三方账号等方式避开防沉迷系统监控。《条例》增加的直播中真实身份信息动态核验能够有限弥补此项漏洞。

对于具体的身份核验,2023年8月9日发布国家标准《信息安全技术 敏感个人信息处理安全要求(征求意见稿)》在其第7.7.4条中要求处理不满十四周岁未成年人的个人信息的活动在全场景下进行身份与年龄核验,并对核验流程进一步细化。

2.处理未成年人个人信息的额外要求

在《个人信息保护法》的基础上,《条例》第32到第38条强化了互联网产品和服务提供者作为个人信息处理者的义务,例如,严格遵守关于必要个人信息范围和未成年人或其监护人同意个人信息处理的规定;支持未成年人或其监护人便捷查阅、复制、更正、补充、删除未成年人个人信息并按照规定提供转移途径;发生个人信息泄露时,应当立即启动安全事件应急预案,及时告知或警示相关政府部门、未成年人及其监护人;对内部工作人员应当采取权限控制并和相应的技术措施,避免违法处理未成年人个人信息。

值得注意的是,《条例》要求个人信息处理者每年应对所处理的未成年人个人信息进行合规审计,并将审计情况及时报告网信等部门。对比《个人信息保护合规审计管理办法(征求意见稿)》关于处理100万人以上个人信息的才需要每年合规审计、应网信部门要求进行的合规审计才需要报送网信部门的规定,《条例》对于强制个人信息合规审计的门槛大大降低。鉴于许多小微型企业(例如超市、餐饮、网吧、宠物店等)也有可能处理少量未成年人个人信息,这一要求在实践中是否能得到全面执行有待观察。

在未成年人网络沉迷防治上,《条例》规定不得向未成年人提供诱导其沉迷的产品和服务,及时修改可能造成未成年人沉迷的内容、功能和规则,并每年向社会公布防沉迷工作情况,接受社会监督。

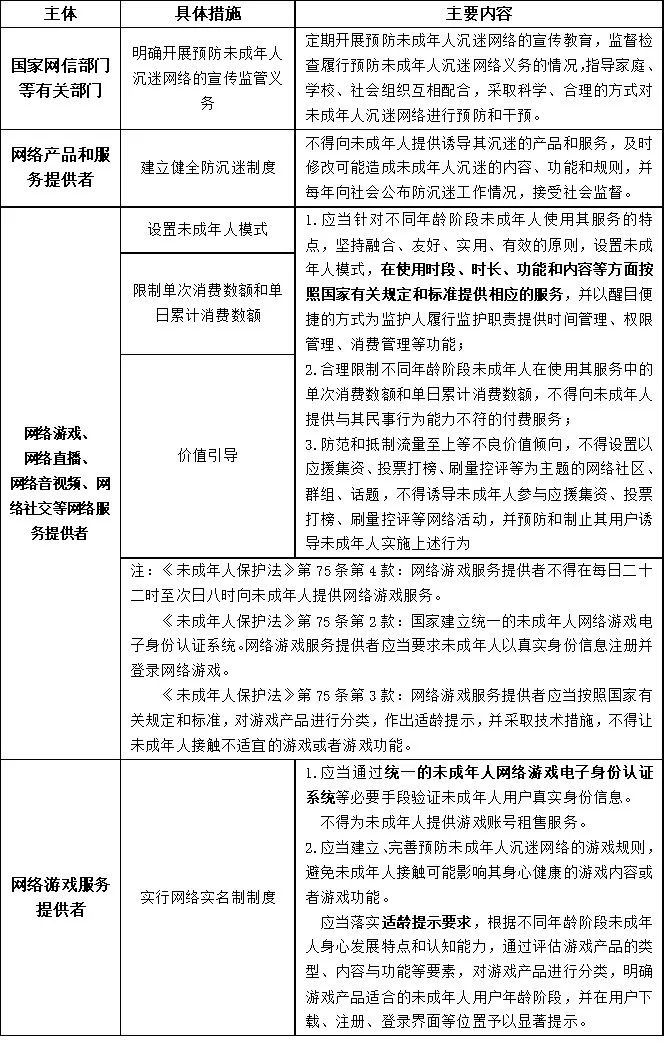

以下是《条例》第43条至第47条针对不同主体的网络防沉迷义务。

《条例》第49条强化治理干预“戒网瘾”乱象,禁止以虐待、胁迫等侵犯未成年人身心健康的方式干预沉迷网络的未成年人,对近年来某些非法“网瘾治疗”恶性事件做出反思和回应。违反该条的未成年人监护人,可能可以根据《条例》第52条由居民委员会、村民委员会、妇女联合会,监护人所在单位,中小学校、幼儿园等单位予以批评教育、劝诫制止、督促其接受家庭教育指导等。提供此类非法“网瘾治疗”的单位或个人,则可以根据《条例》第58条承担民事责任、受到治安处罚甚至承担刑事责任。

在未成年人防沉迷方面,目前国内比较成熟的实践是腾讯成长守护平台的防沉迷系统,即三种管理模式:家长管理的“超级家长模式”,提供腾讯旗下游戏及微信小游戏的游戏时间、游戏消费的通知、查询和管理功能;亲子共建模式“WeTeam”,家长和孩子可组建线上小队,共享游戏数据,约定游戏时长,培养健康游戏习惯;师生互动模式“星星守护”,老师可以加入学生的健康游戏行为培养,通过及时了解学生游戏情况,协助管理学生的游戏行为,培养学生自我管理能力。

未成年人是国家的未来、民族的希望。在数字时代,未成年人作为网络的原住民,触网时间也呈现明显的“低龄化”趋势。如何构建数字时代未成年人网络保护新机制,是世界各国普遍面临的重大挑战。《条例》作为我国该领域第一部专门性的综合性立法,其正式实施将为未成年人网络保护工作指明了发展方向,也对国际社会探索数字时代未成年人网络保护机制建设具有重要启示意义。

如有侵权请联系:admin#unsafe.sh